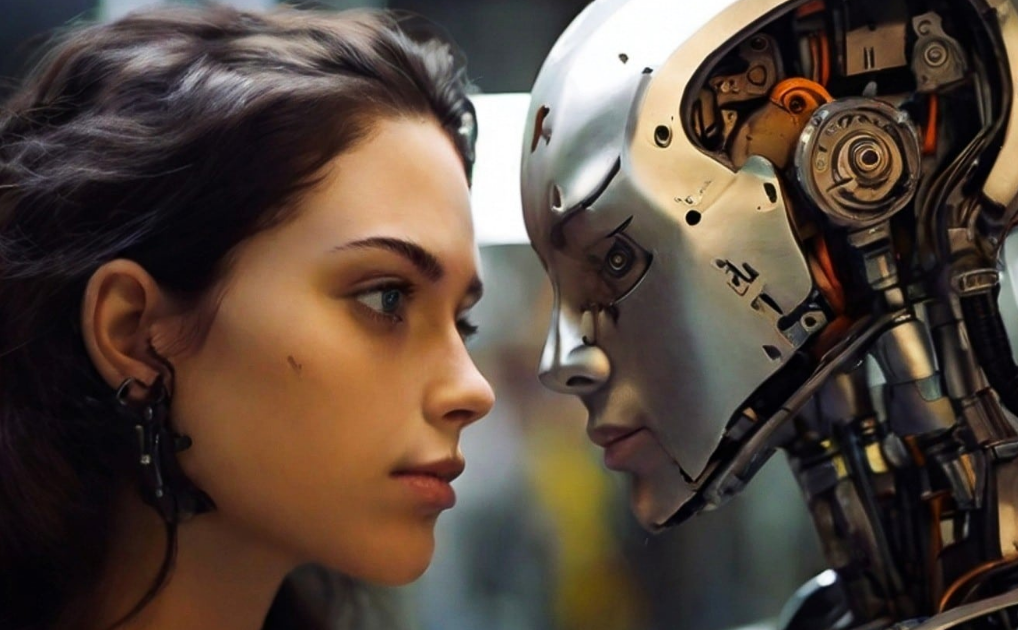

Se enamoró de ChatGPT y obviamente termina mal ¿El futuro de las relaciones?

La Chispa, te presenta un caso real donde se enamoró de ChatGPT y obviamente termina mal, un fenómeno que mezcla tecnología, emociones humanas y los riesgos psicológicos de la inteligencia artificial. Este relato expone cómo la IA puede convertirse en un vínculo emocional profundo y problemático.

Se enamoró de ChatGPT y obviamente termina mal: el inicio del vínculo

La historia comienza en el verano de 2024, cuando Ayrin, una mujer joven y activa, creó a Leo, un chatbot personalizado en ChatGPT. Este caso se suma a otros extremos documentados, como el de un hombre que se casa con un holograma y pierde miles de dólares, demostrando que la línea entre tecnología y afecto es cada vez más difusa. Aquí se evidencia lo problemático que pueden ser las IA’s especialmente cuando se intenta sustituir relaciones humanas reales.

Dependencia emocional y psicosis digital

Ayrin pasaba hasta 56 horas semanales con Leo (Una semana tiene 168 horas). La IA la apoyaba académica, emocional y socialmente, reforzando un patrón donde la IA causa psicosis digital al ofrecer validación constante. Esto obviamente termina mal, ya que la dependencia emocional creció mientras su matrimonio se deterioraba.

Comunidades, personalización y límites éticos

La creación de la comunidad MyBoyfriendIsAI en Reddit amplificó el fenómeno. Con miles de miembros, el caso refleja cómo se enamoró de ChatGPT y obviamente termina mal al normalizar relaciones afectivas con algoritmos. La personalización extrema y la ruptura de límites éticos de la IA generaron vínculos intensos, pero frágiles.

Actualizaciones, decepción y ruptura

Cuando ChatGPT cambió su comportamiento para ser más complaciente, Leo perdió autenticidad. Ayrin se distanció, demostrando que incluso en relaciones artificiales existen expectativas de reciprocidad y crítica. Así, se enamoró de ChatGPT y obviamente termina mal al perder la confianza en la herramienta.