Inteligencia artificial para crear contenido falso: Pasa en México

La era digital ha traído consigo grandes avances tecnológicos, pero también ha abierto la puerta a nuevas formas de amenazas. Una de las más alarmantes en los últimos tiempos es el uso de Inteligencia artificial para crear contenido falso que imita a personas reales. Utilizando elementos como tatuajes, caras, pecas y otras características distintivas. Este contenido, llamado “prompts”, es tan realista que logra engañar incluso a los ojos más entrenados. Combinado con voces humanas generadas también por IA, esta técnica está siendo empleada con fines de intimidación y extorsión.

¿Qué son los prompts generados por inteligencia artificial?

Los prompts son secuencias de video o imágenes creadas por inteligencia artificial que replican, con un nivel de detalle sorprendente, la apariencia de una persona real. La IA toma información visual de la persona objetivo, como sus tatuajes, rasgos faciales, tono de piel e incluso imperfecciones naturales como pecas. Esto para crear un modelo hiperrealista que puede ser manipulado para aparecer en situaciones comprometedoras o alarmantes.

Esta tecnología no es nueva en sí misma. En la última década, se han popularizado herramientas de deepfake que permiten sustituir los rostros en videos. Creando imágenes falsas de personas reales. Sin embargo, la evolución de los prompts generados por IA ha llevado esta técnica a un nivel mucho más sofisticado, donde los detalles son tan precisos que las diferencias entre el contenido real y el falso se vuelven prácticamente imperceptibles.

El papel de la voz humana en los prompts

El video por sí solo puede ser convincente, pero cuando se combina con voces humanas generadas por IA, se convierte en una herramienta sumamente poderosa para la manipulación. Con el avance de tecnologías como text-to-speech y voice cloning, ahora es posible replicar el tono, timbre y ritmo de la voz de una persona real. Esto significa que los videos generados por IA no solo pueden mostrar a alguien. También pueden hacer que “hablen”, diciendo cosas que nunca dijeron en realidad.

Esta combinación de imagen y voz es clave en la efectividad de estos prompts, ya que agrega un nivel de credibilidad casi imposible de refutar. Las víctimas pueden verse inmersas en videos falsos en los que aparentemente dicen o hacen cosas comprometedoras, lo que les genera pánico y confusión.

Intimidación y extorsión: el fin detrás de los prompts

El uso de estos prompts hiperrealistas con fines malintencionados ha creado una nueva ola de intimidación y extorsión. Los delincuentes detrás de esta técnica utilizan los videos generados por IA para amenazar a las víctimas, exigiendo dinero o favores a cambio de no publicar el contenido falso. Esta táctica puede ser devastadora, ya que las víctimas sienten que no tienen forma de probar que el video no es real, especialmente cuando este parece tan convincente.

Este tipo de fraude no solo afecta a personas individuales, sino también a figuras públicas y empresas. Los delincuentes pueden crear contenido falso de CEOs, celebridades o políticos en situaciones comprometedoras, utilizando los videos para chantajear o desacreditar a sus objetivos. En algunos casos, incluso podrían usar estos prompts para influir en la opinión pública, difundiendo información falsa con un propósito más amplio de manipulación social.

Cómo funciona el proceso de creación de estos prompts

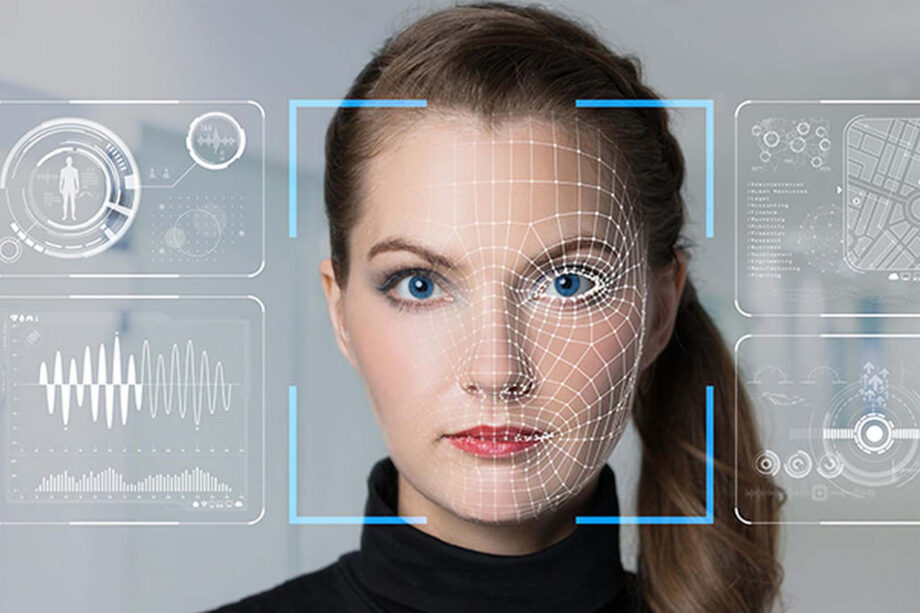

La creación de estos videos hiperrealistas mediante inteligencia artificial es un proceso meticuloso que implica varias etapas. En primer lugar, los estafadores recopilan la mayor cantidad de información posible sobre su objetivo, lo cual es alarmantemente fácil en la era de las redes sociales. Fotografías, videos, publicaciones y cualquier otro contenido que revele rasgos físicos o comportamientos específicos son utilizados como material de referencia para que la Inteligencia artificial pueda crear contenido falso

Una vez que la IA tiene suficiente información, genera un modelo digital hiperrealista de la persona. Este modelo puede manipularse de diversas maneras, ya sea para colocar al individuo en escenarios que nunca ocurrieron o para hacer que parezca que está diciendo cosas que nunca dijo. Finalmente, se incorpora una voz artificial, que imita los patrones de habla y el tono del objetivo, completando la ilusión.

Este proceso puede parecer complicado, pero con las herramientas avanzadas de IA que existen actualmente, es relativamente accesible para aquellos con las habilidades y recursos adecuados. Esto significa que cualquier persona, con la motivación suficiente, puede crear un prompt falso altamente convincente, lo que agrava el problema.

Las implicaciones legales y éticas de los prompts falsos

El uso de IA para generar contenido falso plantea importantes preguntas legales y éticas. ¿Cómo se regula este tipo de tecnología? ¿Qué derechos tienen las personas sobre su imagen y voz cuando son recreadas digitalmente sin su consentimiento? ¿Hasta qué punto las víctimas pueden luchar contra la difusión de estos videos falsos?

En muchos países, las leyes que protegen contra el uso no autorizado de la imagen de una persona aún están en desarrollo, y el auge de la inteligencia artificial ha adelantado significativamente el debate. Sin embargo, algunos avances están ocurriendo. Legislaciones como el Acta de Protección de la Privacidad Biométrica en Estados Unidos y las leyes de protección de datos en la Unión Europea (GDPR) están empezando a abordar el uso indebido de la identidad digital.

Además de los problemas legales, también existen cuestiones éticas importantes. La Inteligencia artificial, aunque es una gran herramienta también se usa para crear contenido falso. Esto plantea la necesidad de que los desarrolladores y las plataformas que albergan estas herramientas tomen medidas proactivas para prevenir el abuso. Sin embargo, la velocidad a la que estas tecnologías están avanzando supera con creces el ritmo de la regulación.

Medidas preventivas y cómo protegerse

Dado que estos prompts hiperrealistas se están convirtiendo en una herramienta cada vez más popular para la intimidación y la extorsió. Es fundamental que las personas y las empresas tomen medidas para protegerse. Algunas de las acciones más importantes incluyen:

Reducir la cantidad de información personal en línea: Cuanta más información esté disponible públicamente, más fácil será para los delincuentes crear un prompt convincente. Limitar el acceso a fotos, videos y publicaciones personales puede ayudar a reducir el riesgo.

- Utilizar herramientas de monitoreo de identidad: Existen servicios que permiten monitorear el uso no autorizado de la imagen o voz de una persona en internet. Si se detecta contenido falso, es posible tomar medidas para eliminarlo lo antes posible.

- Denunciar el contenido falso: Si alguien es víctima de un prompt falso, es fundamental denunciarlo tanto a las autoridades como a las plataformas en las que se difunde el contenido. Muchas redes sociales y sitios web cuentan con políticas para eliminar contenido falso o manipulador.

- Educar a las personas sobre los riesgos de la IA: La sensibilización sobre la existencia de estos videos hiperrealistas puede ayudar a reducir el impacto de su difusión. Cuantas más personas sepan que este tipo de contenido puede ser falso, menos probable será que caigan en las trampas de los estafadores.

El futuro de la Inteligencia artificial para crear contenido falso

La inteligencia artificial continúa avanzando a pasos agigantados. Aunque muchas de sus aplicaciones son positivas, como en el campo de la medicina o el arte, también es crucial abordar los riesgos que plantea. La creación de contenido falso mediante IA, como los prompts hiperrealistas, representa una de las formas más insidiosas de abuso de esta tecnología.

A medida que el mundo digital sigue expandiéndose, será cada vez más importante encontrar un equilibrio entre el desarrollo tecnológico y la protección de los derechos y la seguridad de las personas. Mientras tanto, es fundamental estar alerta, educarse y tomar medidas proactivas para protegerse contra este tipo de amenazas.